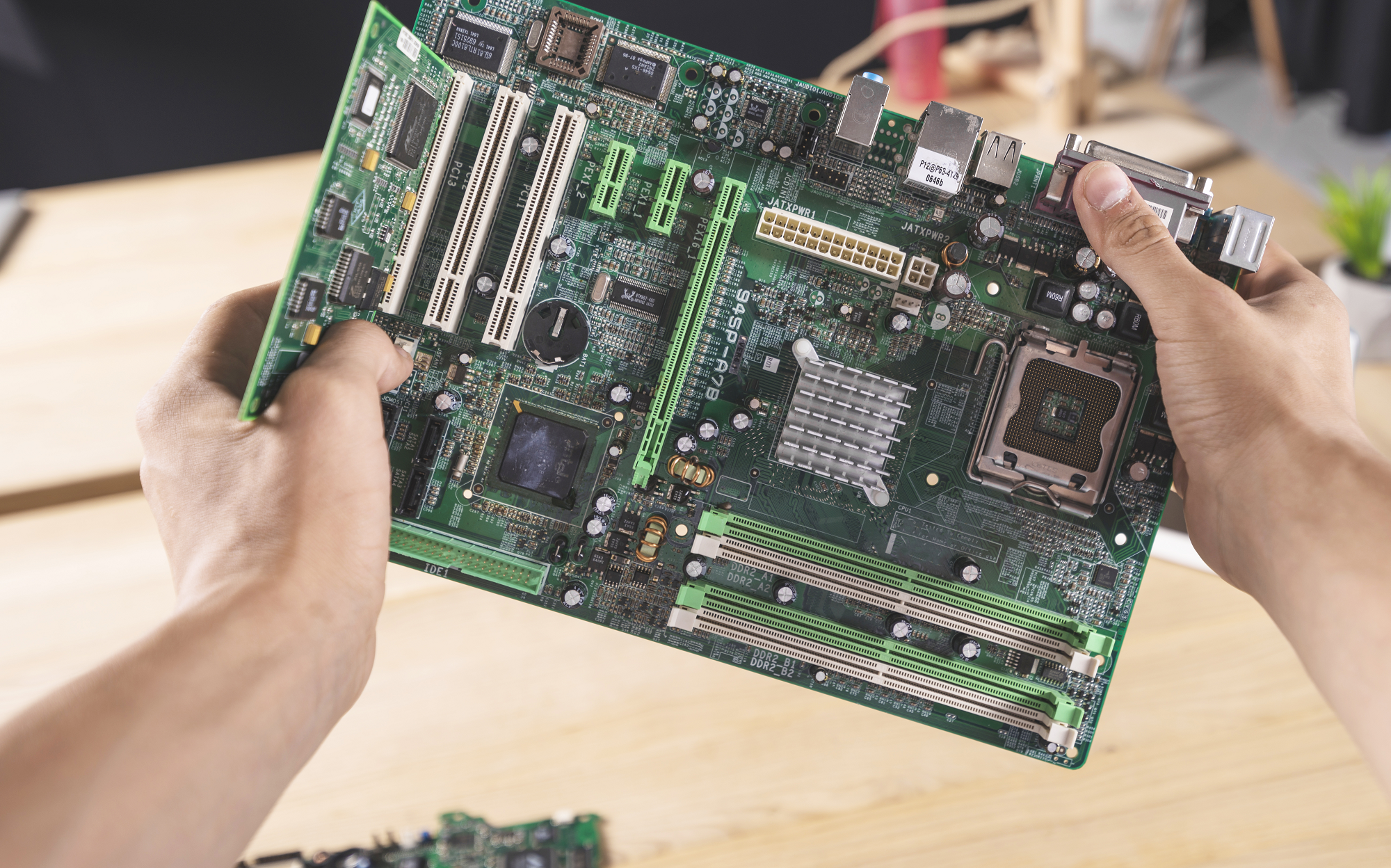

En los últimos años se ha venido hablando con fuerza de la computación cuántica híbrida como la siguiente gran revolución tecnológica. Esta propuesta no busca reemplazar de un día para otro a la computación clásica, sino que trata de integrar con procesadores cuánticos que sirvan para resolver problemas que antes eran impensables. En este contexto, las placas de video, también conocidas como GPU, juegan un papel clave, ya que su arquitectura paralela permite gestionar enormes cantidades de datos con gran eficiencia. La idea de que las GPU acompañen al hardware cuántico no es un capricho: su diseño está naturalmente orientado a acelerar cálculos que complementan los algoritmos cuánticos.

Las placas de video han pasado de ser vistas únicamente como accesorios para juegos o diseño gráfico, a ser reconocidas como herramientas de alto rendimiento en inteligencia artificial, simulaciones y análisis científico. En el Perú, incluso los centros de investigación y las universidades más avanzadas están apostando por laboratorios donde las GPU se integran a prototipos cuánticos experimentales. Esta tendencia marca un giro en la forma en que se entienden los recursos de cómputo: ya no basta con una CPU potente, se requiere una sinergia entre diferentes tipos de procesadores.

El concepto de computación híbrida implica que, mientras el procesador cuántico se encarga de operaciones específicas relacionadas con la superposición y el entrelazamiento, la GPU mantiene el control de tareas complementarias como la optimización clásica, la preparación de datos y la interpretación de resultados. Sin las GPU, la cadena de procesamiento estaría incompleta. No se trata de imaginar un futuro donde los qubits lo hacen todo, sino de reconocer que la colaboración entre GPU y qubits es lo que realmente permitirá dar el salto hacia un modelo más eficiente.

En este marco, se abren debates sobre la vigencia de modelos antiguos de placas frente a los desarrollos más recientes. A pesar de que equipos como la gtx 1060 fueron diseñados originalmente para el gaming, todavía se los considera referentes históricos en el camino hacia la aceleración de cómputos híbridos.

Modelos como el nombrado o su antecesor, la gtx 1050, muestran cómo incluso hardware de gama media en su tiempo sirvió como laboratorio de aprendizaje para la comunidad tecnológica. Mirando hacia atrás, se comprende mejor por qué las tarjetas gráficas se convirtieron en la antesala de lo que hoy se busca con los coprocesadores cuánticos.

Arquitecturas gráficas al servicio del cómputo híbrido

Si bien el mercado siempre está ávido de las últimas generaciones de GPU, resulta clave reconocer que lo que determina su lugar en la computación cuántica híbrida es la arquitectura de procesamiento paralelo. Una GPU moderna puede contar con miles de núcleos que, trabajando en simultáneo, resuelven operaciones matemáticas a velocidades imposibles para una CPU tradicional. Esto es particularmente útil en el campo de la simulación de circuitos cuánticos, donde el espacio de estados crece de manera exponencial con cada qubit adicional.

Los fabricantes han apostado por líneas de productos muy conocidas. Por un lado, NVIDIA con su serie RTX, que incluye la RTX 3060, RTX 3070 y RTX 3090, ha mostrado un enfoque hacia el rendimiento en inteligencia artificial, que es la base de muchos algoritmos híbridos. Por otro lado, AMD no se queda atrás con su serie Radeon RX, como la RX 6700 XT o la RX 6800, que han demostrado ser sólidas competidoras en entornos de programación científica y de aprendizaje automático. Ambas marcas apuntan a la idea de que la GPU no solo sirve para gráficos, sino que es la llave de acceso a nuevas áreas de la computación.

Una diferencia interesante en el contexto peruano es que muchos laboratorios universitarios trabajan con modelos de media gama que ofrecen un balance entre consumo de energía y rendimiento. Mientras que en países con grandes centros de datos se instalan GPU de alta gama como la NVIDIA A100, en entornos más modestos se busca optimizar la inversión con modelos que siguen siendo vigentes para proyectos de investigación aplicada. La noción de accesibilidad es central en la adopción de estas tecnologías híbridas.

Además, la evolución de las librerías de programación como CUDA, ROCm y OpenCL ha permitido que los programadores adapten sus algoritmos a diferentes arquitecturas gráficas. Este ecosistema de software es el que realmente da vida al hardware, ya que, sin compatibilidad ni herramientas de desarrollo, la GPU por sí sola no podría cumplir un rol en la computación cuántica híbrida. La interacción entre hardware y software es, entonces, otro de los puntos que no se pueden perder de vista al pensar en el futuro de este campo.

La transición hacia ecosistemas híbridos

En la práctica, la computación cuántica aún enfrenta limitaciones como la decoherencia y los errores de lectura, por lo que depender exclusivamente de procesadores cuánticos todavía no es viable para la mayoría de aplicaciones. Allí es donde las GPU se convierten en socias estratégicas. Al encargarse de simular, corregir o incluso entrenar modelos que se combinan con datos cuánticos, las placas de video logran que el sistema completo mantenga un rendimiento aceptable. La tendencia hacia ecosistemas híbridos no es una simple especulación: ya existen prototipos que se utilizan en investigación académica y en corporaciones de tecnología avanzada.

Un ejemplo claro son las colaboraciones que integran NVIDIA con cuQuantum o IBM con Qiskit, donde las GPU funcionan como nodos auxiliares en procesos de optimización. Estas plataformas están demostrando que no es necesario esperar décadas para usar lo cuántico, sino que ya hoy se puede trabajar en modelos híbridos. Incluso a nivel de startups en Latinoamérica, se observa un interés creciente en aprovechar hardware gráfico disponible comercialmente para integrarse a proyectos de investigación en cómputo cuántico.

La visión de futuro apunta a que los desarrolladores puedan usar lenguajes de programación accesibles, como Python, para crear soluciones que mezclen algoritmos clásicos y cuánticos. Las GPU hacen posible que esa integración no se quede en un plano teórico, sino que sea tangible en laboratorios, centros de datos y universidades. Por eso, no es exagerado decir que la historia de la computación cuántica híbrida también es, en gran medida, la historia de cómo se han perfeccionado las placas de video en las últimas dos décadas.

El rol de la energía no puede dejarse de lado. Las GPU modernas son potentes, pero también demandan un consumo eléctrico considerable. En un país como el Perú, donde la estabilidad energética no siempre es la misma en todas las regiones, esto se convierte en un factor a considerar. Sin embargo, se están diseñando modelos con mayor eficiencia por vatio, lo cual se alinea con las necesidades de los ecosistemas híbridos. El futuro se dirige hacia hardware que combine potencia con sostenibilidad.

Finalmente, es importante reconocer que la transición hacia sistemas híbridos no solo depende de hardware y software, sino también de la formación de profesionales capacitados. La comunidad de desarrolladores en el Perú está creciendo, con iniciativas locales que capacitan en computación cuántica y en programación de GPU. Este factor humano es lo que asegurará que la tecnología realmente sea aprovechada en su máximo potencial.